di Raffaele Gaito

Negli ultimi mesi abbiamo letto ovunque titoli allarmanti: “Il 95% dei progetti di intelligenza artificiale fallisce”. La frase, riportata da giornali italiani e internazionali, sembra decretare la fine della rivoluzione tecnologica che stiamo vivendo. Eppure, come spesso accade, i numeri raccontati in maniera superficiale finiscono per creare più confusione che consapevolezza. Quel dato nasce da un report del MIT, fonte certamente autorevole, ma che è stato interpretato e diffuso in modo riduttivo, quasi sensazionalistico, senza entrare nel merito delle sue reali conclusioni.

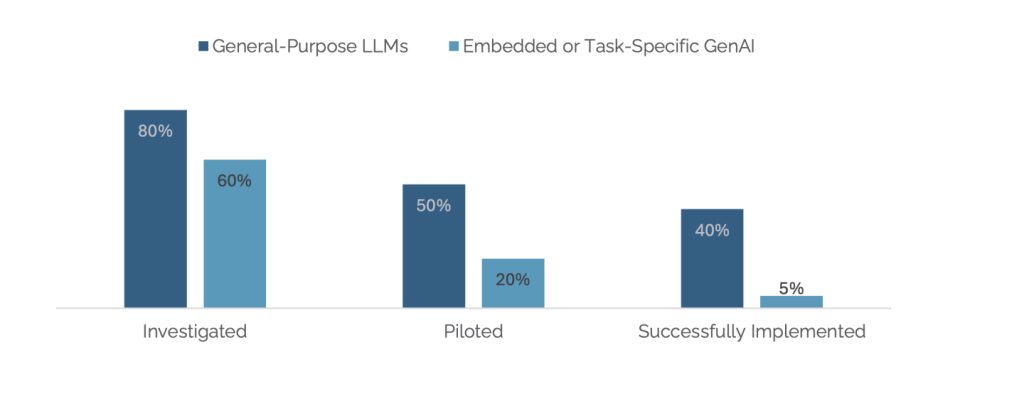

Per comprendere meglio la questione bisogna partire da una distinzione fondamentale che molti articoli hanno ignorato. Il report non mette sullo stesso piano tutti gli strumenti di AI: da una parte ci sono i modelli generalisti, i cosiddetti General Purpose LLMs come ChatGPT, Gemini, Claude o Grok, strumenti che chiunque può utilizzare con un abbonamento da poche decine di euro al mese; dall’altra ci sono le soluzioni enterprise su misura, costose, sviluppate ad hoc dai grandi fornitori e spesso calate dall’alto da società di consulenza. Il famoso 95% di fallimenti riguarda esclusivamente quest’ultima categoria. Tradotto: non ha nulla a che vedere con l’uso quotidiano e diffuso degli LLM che milioni di persone stanno già integrando nei propri flussi di lavoro con risultati concreti.

Anche sul piano numerico la lettura corretta è molto diversa da quella che ha fatto il giro delle redazioni. Il report racconta che il 40% delle aziende intervistate non ha nemmeno preso in considerazione l’AI. Un altro 40% si è fermato alla fase di valutazione iniziale. Soltanto il 20% ha deciso di avviare un progetto pilota e, tra queste, il 25% ha dichiarato di aver avuto successo. È un dato basso, certo, ma ben lontano dall’immagine di un fallimento totale. Ancora più interessante è la fotografia legata agli LLM generalisti: il 50% delle aziende intervistate ha avviato un pilota su strumenti come ChatGPT e, di queste, l’80% ha riportato esiti positivi. Numeri che mostrano un quadro diametralmente opposto rispetto al catastrofismo mediatico.

Ci sono poi i limiti del report stesso, che andrebbero sempre tenuti a mente. Il campione è ridottissimo, solo 52 organizzazioni in totale, distribuite in maniera disomogenea tra i vari settori. In alcuni verticali si parla di appena tre casi, un numero che non può certo permettere di trarre conclusioni generali. Inoltre, la definizione di “successo” varia da azienda ad azienda: per alcune significa riduzione dei costi, per altre aumento di fatturato, per altre ancora miglioramento dei margini o dei processi interni. E soprattutto, la metodologia si basa su interviste, quindi su percezioni soggettive, non su metriche oggettive. Parlare di fallimento o successo basandosi su opinioni non è la stessa cosa che analizzare numeri concreti.

Se si leggono attentamente i dati, emergono riflessioni ben più utili di un titolo gridato. La prima riguarda il cosiddetto bias di conferma: molti manager e imprenditori hanno colto al volo quel 95% come scusa per non muoversi, per autoassolversi e dire “vedi, avevamo ragione a non investire in AI, non funziona”. È un atteggiamento pericoloso. La tecnologia non sparirà, anzi, cresce a una velocità superiore a quella che ebbe internet nei suoi primi anni. Chi sperimenta oggi, chi costruisce casi d’uso solidi, chi impara a capire come integrare l’AI nei propri processi farà la differenza domani. Chi invece resta fermo rischia semplicemente di essere tagliato fuori.

La seconda riflessione riguarda proprio la sperimentazione. Il vero dato sconfortante del report non è il tasso di insuccesso, ma la scarsità di progetti pilota. Troppe aziende non hanno nemmeno provato a sporcarsi le mani. È qui che si gioca la partita: testare in piccolo, capire come l’AI può supportare marketing, vendite, comunicazione, customer care o operations, raccogliere numeri reali e poi decidere se scalare. Senza questa fase preliminare si resta ostaggio di contratti enterprise calati dall’alto, pacchetti costosi e spesso rigidi che rischiano di creare lock-in difficili da gestire.

C’è poi un fenomeno che il report mette bene in luce e che in pochi hanno evidenziato: la cosiddetta shadow economy dell’AI. Il 90% delle persone intervistate utilizza strumenti di intelligenza artificiale nel proprio lavoro quotidiano, anche se spesso non lo dichiara. E-mail, report, contenuti, analisi: gran parte di queste attività passa già da ChatGPT e simili, ma senza che i manager lo sappiano. Questo significa che le aziende sono già attraversate dall’AI, volenti o nolenti. Ignorare il fenomeno non lo fa sparire, lo rende solo più rischioso, perché si lavora senza regole, senza attenzione alla privacy, senza procedure condivise.

Alla fine, il report del MIT non è un atto d’accusa contro l’intelligenza artificiale, ma un avvertimento: mostra gli errori che molte aziende stanno commettendo e offre spunti preziosi per non ripeterli. Il punto non è se l’AI funziona o meno, ma come viene adottata. E la differenza tra chi resterà indietro e chi farà il salto non sarà data da un numero isolato, ma dalla capacità di sperimentare, imparare e trasformare davvero la tecnologia in valore.

⚙️

Leggi altri articoli di Raffaele Gaito:

- La coerenza dei personaggi nelle immagini AI: perché la funzione Character di Ideogram è un punto di svolta

- L’AI entra in radio: il caso IAM e la nascita dell’artificial pop

- Veo 3 e il realismo sintetico: una sfida etica e culturale

- Secondo Apple, i modelli ragionanti non ragionano. È davvero così?